Uno dei concetti più fondamentali, nel mondo della fisica, scaturì dalla mente di Albert Einstein agli inizi del secolo scorso; tale concetto, che emerse dalla legge della Relatività Ristretta (esposta in un celebre articolo del 1905), dichiarava semplicemente quella che sarebbe presto divenuta la dicotomia più famosa al mondo, ovvero: l’equivalenza di massa ed energia (espressa con l’indimenticabile formula “E=mc^2” ).

Ciò che si arrivò a comprendere quindi, indubbiamente non con poche difficoltà a livello di “pura intuizione”, fu appunto questa sostanziale uguaglianza tra il concetto di massa e quello di energia. La massa, andava quindi considerata solo ed esclusivamente come una forma complessa di energia.

Di certo non fu facile per i fisici di un tempo, familiarizzarsi subito con questa nuova e straordinaria visione della realtà; di fatto occorsero parecchi anni, affinché gradualmente nel mondo accademico venisse pienamente accettata questa nuova “corrente di pensiero”.

Una svolta decisiva a favore di questo nuovo paradigma, la diedero indubbiamente i due scienziati tedeschi Otto Hahn e Fritz Strassmann, quando nel dicembre del 1938, scoprirono la fissione nucleare. Bombardando l’Uranio con neutroni, scoprirono fra i prodotti di reazione alcuni elementi di numero di massa intermedio, come il Bario radioattivo, la cui presenza inizialmente era inspiegabile. Nel 1939, Lise Meitner e Otto Frisch, annunciarono la soluzione di questo enigma. Queste scoperte diedero quindi ad Einstein la conferma dell’equivalenza di massa ed energia, ben 34 anni dopo che egli l’ebbe prevista!

Sono trascorsi circa settant’anni, a partire da quel lontano 1939, e da allora sino ad oggi si può dire che la nostra visione della realtà, poggi ancora saldamente le sue basi sulla famosa equazione di Einstein (“E=mc^2”) e su ciò che sostanzialmente essa ci porta a considerare, ovvero: massa ed energia sono la stessa e identica cosa, ma con aspetti diversi e quindi, per ragioni di praticità, definite con nomi diversi.

In questi ultimi anni, grazie anche alle innumerevoli nuove scoperte nel campo della computazione quantistica, molti fisici hanno però iniziato a porsi anche la seguente domanda: Ma se la massa non è nient’altro che una forma complessa di energia, volendo andare oltre, in ultima analisi, quale sarebbe il “costituente fondamentale” dell’energia?

Ebbene una risposta a questa domanda, potrebbe essere la seguente:

L’Energia non è nient’altro che una forma complessa di Informazione; per cui il costituente fondamentale dell’Energia, altro non è che Informazione nel suo stato fondamentale.

Ma cerchiamo di capire i motivi che mi hanno spinto a formulare questa affermazione, e soprattutto di individuare le basi su cui poggia tale ipotesi.

Verso gli inizi degli anni cinquanta, l’ingegnere e matematico americano Claude Elwood Shannon, gettò le basi teoriche di quella che sarebbe stata entro pochi anni riconosciuta come la: Teoria dell’Informazione. Uno degli aspetti più curiosi ed interessanti che emerse da tale teoria, fu la stretta correlazione tra l’entropia termodinamica e quella invece relativa all’Informazione di un sistema dato. In parole povere, ciò che in ultima analisi si arrivò a comprendere, è che per qualsiasi aumento di entropia termodinamica, corrisponde una perdita di Informazione su un dato sistema, e viceversa.

L’unità di misura di una determinata quantità di Informazione, è espressa con il termine bit. Ora, per fare un esempio, se noi portiamo un dato sistema ad una temperatura prossima allo zero assoluto, la sua entropia diminuirà sino a valori pressoché nulli, e di conseguenza il suo “livello” di Informazione tenderà al massimo consentito.

A questo punto, compiendo alcuni semplici ragionamenti analogici, viene da porsi le seguenti domande: Ma se con l’aumentare dell’entropia di un sistema, è riscontrabile contemporaneamente anche una perdita della quantità di energia (calore) di tale sistema, ed oltre a ciò abbiamo parallelamente anche una perdita di Informazione sempre riferita al sistema in questione, quest’ultima, non potrebbe essere associata-legata alla quantità di energia (calore) che si disperde nell’ambiente circostante a causa del secondo principio della termodinamica? E se così fosse, in che modo sarebbe ad essa legata? Qual’è la sottile linea di confine tra un bit di Informazione e un elettronvolt di energia? Ma stiamo parlando di due cose differenti (bit ed elettronvolt), oppure della stessa identica cosa, ma con aspetti differenti (come nel caso dell’equivalenza di massa ed energia)? E se alla fine scoprissimo che bit ed elettronvolt rappresentano semplicemente due tipi di unità di misura, con cui possiamo definire il concetto fondamentale di Energia? Bè, allora sarebbe lecito chiedersi: Ma quante migliaia, milioni oppure miliardi di bit occorrono per costituire un singolo elettronvolt (o Joule) di energia?

Non dimentichiamoci del fatto che nell’Equazione di Schrödinger la funzione d’onda descrive un’ampiezza di probabilità, e nessuno ci impedisce di sostituire/ridefinire tale ampiezza (P) con una determinata quantità di Informazione (I)!

Ecco quindi in sostanza da dove nasce la mia ipotesi di considerare l’Informazione, come una sorta di costituente fondamentale dell’Energia.

Giustamente a questo punto qualcuno potrebbe chiedersi: Ma come, una perdita di energia (calore) comporta un AUMENTO dell’informazione e non una diminuzione.

Veniamo quindi alla risoluzione di tale paradosso.

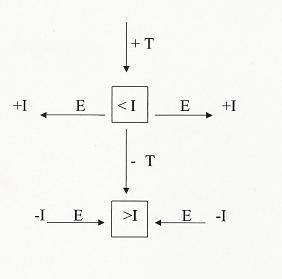

Si consideri un corpo qualsiasi dotato di una certa massa; se noi aumentiamo la temperatura (T) di tale corpo, avremmo un flusso di energia (E) che dal corpo in questione si sposta nell’ambiente ad esso circostante. Il corpo quindi giustamente perderà una determinata quantità di Informazione (I) e ci apparirà come un sistema dotato di una notevole entropia; l’informazione che il corpo perderà però, si sposterà semplicemente nell’ambiente ad esso circostante, aumentandone l’Informazione.

Ecco perché noi non potremo mai misurare-osservare tale Informazione; per il fatto che essa rimarrebbe sempre fuori da qualsiasi corpo o sistema entropico termodinamico.

Non è da escludersi quindi che tale “informazione in eccesso”, possa andare a confluire in una o più dimensioni nascoste, previste nella Teoria delle Stringhe.

Contrariamente invece, nel caso in cui diminuissimo la temperatura (T) di tale corpo, andremmo a rallentare il flusso di energia (E) che dal corpo si sposta nell’ambiente ad esso circostante.A temperature prossime allo zero assoluto, il flusso di energia sarebbe pressoché nullo; in questo caso l’Informazione(I) non avrebbe alcun modo di passare dal corpo in questione all’ambiente ad esso circostante. Il corpo quindi disporrebbe della quantità massima consentita di Informazione.

Riflettiamo un attimino su questa domanda: Nel momento in cui un sistema perde una determinata quantità di Informazione, questo cosa comporterebbe, forse che tale informazione, essendo legata all’energia (calore) durante il processo entropico, debba anch’essa disperdersi nell’ambiente circostante sino a “dissolversi” completamente?

Riflettiamo un attimino su questa domanda: Nel momento in cui un sistema perde una determinata quantità di Informazione, questo cosa comporterebbe, forse che tale informazione, essendo legata all’energia (calore) durante il processo entropico, debba anch’essa disperdersi nell’ambiente circostante sino a “dissolversi” completamente?

Se così fosse avremmo a che fare con due “campi di informazione dinamica” della stessa intensità, in grado di interagire tra loro, di fondersi l’uno con l’altro, e infine di “dissolversi” nell’ambiente circostante al sistema considerato. Ma così non è, fortunatamente. [per campo d’informazione dinamica, intendo semplicemnte una quantità di informazione in grado di muoversi nello spazio e nelle dimensioni, auto-organizzantesi e costante nel tempo,ossia che non segue assolutamente il secondo principio della termodinamica (principio entropico). E quindi per questo motivo,praticamente eterna].

Un “campo di Informazione dinamica”, costituito da una determinata quantità di bit di Informazione, entro certi limiti di intensità, non potrà mai andare a costituire un singolo elettronvolt o Joule di energia. Ragion per cui, esso stesso (non potendo interagire con il resto dell’energia del sistema, molto più intensa e misurabile con strumenti fisici poiché in grado di interagire con i diversi campi elettromagnetici del sistema in questione), rimane sempre indipendente da qualsiasi processo entropico termodinamico.

La cosa più importante che possiamo dedurre da queste ultime considerazioni, è che un “campo di informazione dinamica” che rientri entro certi limiti di intensità, non è vincolato da alcun tipo di processo entropico termodinamico. Ne segue a volte l’andamento, ma non è soggetto ad alcuna interferenza di campo. Esso è quindi in grado di auto-organizzarsi, ossia di mantenere costante e regolare la sua struttura nel tempo, senza alcuna interferenza da parte dei comuni campi di energia che vanno a costituire l’ambiente del sistema considerato. Inoltre, esso sarà in grado di fondersi con altri campi di informazione dinamica della stessa intensità, e quindi di accrescere la sua estensione nello spazio, ma non necessariamente il suo livello di intensità.

Ed ora andiamo a scoprire cosa ha a che fare tutto ciò che vi ho esposto sinora, con il concetto di Anima.

La mente umana, come ben sappiamo, produce un determinato campo magnetico nell’ordine delle decine di femtoTesla (1 fT = 10^–15 T).

Questo campo, lo dobbiamo semplicemente alla nostra attività cerebrale.

Già allo stato fetale, ossia pochi mesi prima della nostra nascita, il nostro cervello, grazie alla sua costante attività, produce un campo di informazione dinamica che dal momento in cui veniamo al mondo, continua negli anni a farsi sempre più intenso, sino a raggiungere un determinato limite. Ora è assolutamente necessario che vi sia ben chiara una cosa: il campo di informazione dinamica prodotto dall’attività cerebrale e quello elettromagnetico (molto più intenso, che potremmo definire “di scarto”,poiché non è nient’altro che il risultato del lavoro che compie il nostro cervello in attività, per produrre i nostri “pensieri”, i quali in ultima analisi vanno a costituire il nostro campo di informazione dinamica), sono due cose ben diverse e non interagiscono l’una con l’altra!

Se proprio vogliamo, possiamo identificare il campo di informazione dinamica del nostro cervello, come una sorta di “risonanza” del campo magnetico dovuto all’attività cerebrale (molto più intenso e quindi misurabile con strumenti fisici).

Su scale prossime alla lunghezza di Planck,spazio e tempo perdono qualsiasi significato fisico;per tale ragione anche il concetto stesso di energia risente di tale condizione (non dimentichiamoci che in natura non può esistere alcuno spazio “vuoto di campo”,ossia di energia; tanto è vero che persino il vuoto quantistico, sia esso il falso o il vero vuoto,è in ogni caso colmo di particelle virtuali – Feynman docet). Un campo di Informazione dinamica, va quindi a definire-costituire quella parte della realtà del tutto imponderabile e inosservabile con strumenti fisici, poichè al di sotto di quel limite definito dalla lunghezza di Planck. Per questo motivo quindi, qualsiasi tipo di “risonanza” che prendesse forma o scaturisca da determinate onde cerebrali, ponendosi al di sotto della soglia di Planck, sarebbe indipendente da qualsiasi forma di interazione con il mondo subnucleare (formato da quark,gluoni e via dicendo).

Come abbiamo precedentemente visto, un campo di informazione dinamica è in grado di auto-organizzarsi, ossia di mantenere costante e regolare la sua struttura nel tempo, senza alcuna interferenza da parte dei comuni campi di energia che vanno a costituire l’ambiente del sistema considerato (in questo caso: mente umana – ambiente ad essa circostante).

Ecco quindi in quali termini potremmo intendere il concetto di Anima; ovvero, essa è da considerarsi un particolare tipo di campo di informazione dinamica, in grado di dissociarsi dal corpo fisico che lo “ospita”, nel momento in cui non vi sono più i presupposti per poter rimanere legato alla propria sorgente elettromagnetica (attività cerebrale).

Affermare quindi che l’Anima non “muore” mai, è quindi in linea di principio del tutto corretto. Affermare che gli animali (oltre alla specie umana) hanno un’Anima, anche in questo caso è in linea di principio corretto.

Tutte queste ipotesi e considerazioni, sono a mio avviso totalmente in accordo e “affini” alla teoria di Rupert Sheldrake sui campi morfogenetici, a quella di Richard Dawkins sulla Trasmissione dei Memi (memetica), e infine a quella di Carl Gustav Jung sull’Inconscio collettivo.

Nella “scienza ortodossa”, tutto il discorso sull’interazione tra Entropia termodinamica e Informazione, risulta valido solo ed esclusivamente su sistemi isolati (chiusi e aperti) in cui è presente un osservatore in grado di interagire con il sistema considerato e quindi di rilevare-calcolare tutto ciò che accade all’interno del sistema stesso (di cui egli fa parte). Questa condizione è quindi l’unica che ci è consentito di conoscere, sulla base della quale siamo in grado di misurare-calcolare ogni passaggio di stato dell’energia, con rispettivi livelli di entropia (termodinamica e dell’Informazione) e quantità di Informazione. Da questo assunto, si arriva quindi alla seguente conclusione: Per qualsiasi osservatore che si trovi all’interno di un sistema termodinamico, è assolutamente impossibile misurare-calcolare un’eventuale quantità di Informazione che si sposti o si trovi al di fuori del proprio sistema di riferimento. Nell’ipotesi a Molti Mondi di Everett, tutte queste mie considerazioni trovano sicuramente terreno fertile. Non ho comunque intenzione in questa sede di spingermi oltre verso una tale direzione,poichè vista la complessità dell’argomento, non credo proprio sia il caso.

Le parole che riporterò qui di seguito, sono del fisico Frank J.Tipler, non le mie:

“(…)tutte le entità presenti nell’Universo attuale,codificano una quantità di informazione di gran lunga inferiore alla quantità permessa dalla teoria quantistica dei campi. Per esempio,se un atomo di idrogeno dovesse codificare tutta l’informazione che gli è consentita dal limite di Bekenstein,potrebbe codificare circa 4 x 10^6 bit di informazione (…)Quindi un atomo di idrogeno potrebbe codificare all’incirca un megabyte di informazione,mentre di norma codifica molto meno di un bit.La massa dell’idrogeno non viene di certo utilizzata in modo efficiente!Se si assume che il raggio sia quello di un protone (R= 10^-13 cm),la quantità di informazione codificabile nel protone è costituita da soli 44 bit!Questo valore è davvero piccolo rispetto alla complessità del protone – tre quark valenza,innumerevoli quark e gluoni virtuali- che è di fatto tanto complesso che non siamo ancora riusciti a calcolarne lo stato di base dai principi fondamentali utilizzando il Modello Standard, anche utilizzando i supercomputer più avanzati”

Bene, ora io mi chiedo:

In che modo vogliamo cercare di risolvere questo,chiamiamolo: “enigma dell’Informazione mancante”? Rimanendo saldamente ancorati allo spazio-tempo di Minkowski, oppure cercando di andare un attimino oltre a questo concetto di realtà,abbracciando magari l’idea di un Universo a più dimensioni (vedasi teorie delle stringhe) e non da ultima,anche l’ipotesi a Molti Mondi di Everett? Fintantoché continueremo a relegare tali teorie nel mondo della matematica,dubitando fortemente di un loro potenziale coinvolgimento nella realtà fisica a noi nota, difficilmente riusciremo a fare qualche passo avanti nella comprensione di tutto ciò che attualmente accantoniamo nel mondo della fantascienza e del paranormale.

La cosa che mi fa più rabbia, è che Schrödinger l’ha già dimostrato più di mezzo secolo fa che in definitiva noi non siamo nient’altro che onde di probabilità … ma nessuno sembra ancora volerlo capire.

Per chi volesse scaricare l’articolo (aggiornato,in versione integrale) in formato PDF,questo è il link:

Fausto Intilla, 31 agosto 2009

Note

Per un approfondimento sulle Basi fisiologiche dei segnali bio-elettromagnetici, vedasi Appunti del corso integrativo tenuto dal dott. Andrea Brovelli nel modulo di Neuroscienze per gli studenti del Corso di Laurea in biotecnologie dell’Università di Trieste: http://fc.units.it/ppb/Segnali/Segnali1.html

Per ulteriori informazioni sul lavoro di Intilla: http://www.oloscience.com/

Articolo di F. Intilla – Fonte: http://www.spaziomente.com

Trovato su: http://www.lorecalle.it/?p=212